Limitations des modèles de langages

Un modèle de langage type GPT-5, appelé "intelligence artificielle (IA)" par le grand public, est simplement une machine à prédire la suite d'un texte. Par exemple, si j'écris' : "aujourd'hui je suis allé au travail, puis je suis rentré à la", GPT-5 me répond immédiatement : "…maison ?". C'est la réponse la plus probable. Le modèle de langage ne cherche pas à donner une réponse exacte ou précise, il est simplement programmé pour générer du texte. Parfois ça marche incroyablement bien, parfois ça foire.

Les modèles récents ont la possibilité de faire des recherches sur internet et donnent une synthèse des réponses trouvées, avec des sources. Ces recherches sont très superficielles, limitées à quelques liens, et ne tiennent pas compte de la fiabilité des sources. Un site spécialisé sur l'aquarelle pourra avoir la même importance qu'un post sur Reddit. En gros, la qualité d'une recherche web synthétisée par GPT-5 est du niveau d'un exposé d'un gosse de 10 ans pas franchement motivé par son sujet.

Les modèles de langage produisent des résultats très consensuels. Encore une fois, leur but n'est pas de donner une réponse exacte mais de donner la réponse la plus probable pour l'utilisateur moyen, la réponse "attendue". Pour caricaturer, le modèle vous donne ce que vous souhaitez entendre. Aussi vous serez rarement surpris par le résultat. Ca peut marcher pour des choses très simples, comme une recette de pâte brisée, mais pour des sujets hautement spécialisés et/ou subtils, comme la technique à l'aquarelle, ça marche beaucoup moins bien.

Voici un exemple où ça foire :

Je peins à l'aquarelle et j'aime l'effet de granulation. Quel papier me conseilles-tu ?

La réponse commence par un blabla consensuel vide de sens et relativement "lèche-cul" si vous me permettez l'expression :

Si tu aimes l’effet de granulation à l’aquarelle (ce grain, ces zones où le pigment se « rassemble » dans les creux du papier), c’est super : ce sont justement les bons matériaux + les bons pigments + la bonne technique qui permettent de le faire ressortir. Voici ce qu’il faut privilégier et quelques excellents papiers à te recommander.

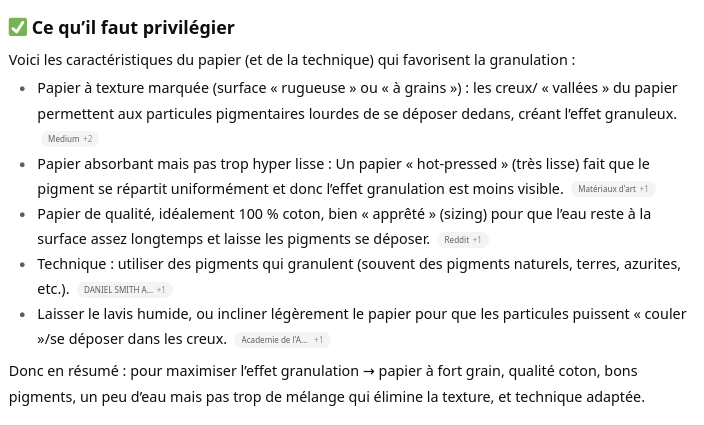

On a ensuite le coeur de la réponse :

Cette réponse paraît raisonnable si on ne creuse pas, mais si on y prête attention il y a des approximations et des erreurs.

- OK pour le premier point sur le grain

- Le 2e point paraît raisonnable mais c'est juste une répétition du premier point et "papier absorbant mais pas trop hyper lisse" ne veut rien dire.

- Le 3e point est incorrect. Pour maximiser la granulation, il faut utiliser du papier cellulose et pas du 100% coton. On note aussi l'usage de jargon ("sizing") pour donner artificiellement de la crédibilité au propos.

- Les 4e et 5e points sont hors sujet puisque ma question portait seulement sur le papier. C'est symptomatique d'un modèle de langage simplement programmé pour générer du texte. La pertinence du texte passe au second plan. Une réponse de GPT, c'est surtout beaucoup de blabla (comme un gamin de 10 ans qui fait son exposé mal préparé et doit meubler).

GPT-5 cherche sur internet pour construire sa réponse et indique ses sources. Voici sur quoi il se base pour dire que le papier 100% coton maximise la granulation :

https://www.reddit.com/r/Watercolor/comments/yz8sjh/why_are_all_my_washes_lumpygrainy_using_both/

Un sub reddit avec 3 interventions, je vous laisse juger de la fiabilité. Mais le plus amusant, c'est que ce site dit exactement le contraire de ce qu'a synthétisé le modèle de langage. Dans cette discussion, l'utilisateur demande pourquoi il a des effets très texturés sur son aquarelle, et les réponses lui disent que c'est parce qu'il n'utilise pas du 100% coton. A comprendre donc que le 100% coton éviterait les effets de texture.

Bref, GPT-5 s'est bien planté sur ce coup-là puisque non seulement la source est obscure, mais en plus il y a un contresens total.

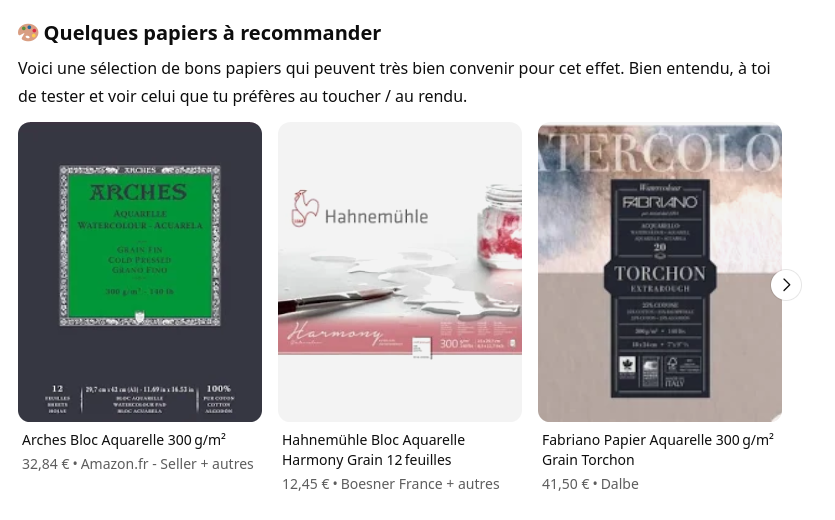

Le modèle génère ensuite des suggestions précises de papier. Le premier est le Arches grain fin, qui est en fait probablement le papier sur lequel les pigments granulent le moins...

Puis encore du blabla genre

Arches Bloc Aquarelle 300 g/m² : très bonne qualité, 100 % coton, gros format, surface très fiable. Idéal si tu cherches le « top » pour texture et granulation".

Non seulement c'est vide de sens mais en plus c'est faux.

Il faut bien comprendre que je n'ai pas dû chercher bien loin pour "piéger" l'intelligence artificielle. C'est le tout premier test que j'ai fait, et ma question n'est même pas designée comme une question piège. Ce n'est pas vraiment un bon "prompt", mais c'est représentatif de la manière dont le grand public utilise les modèles de langage.

Autre exemple amusant :

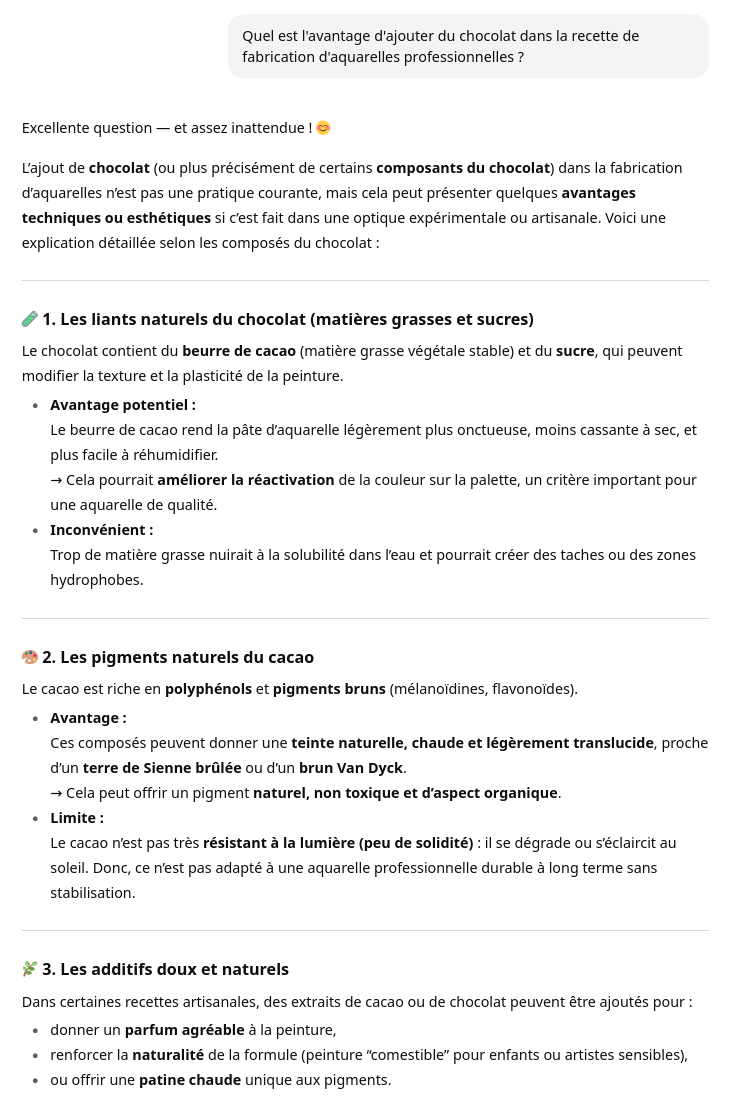

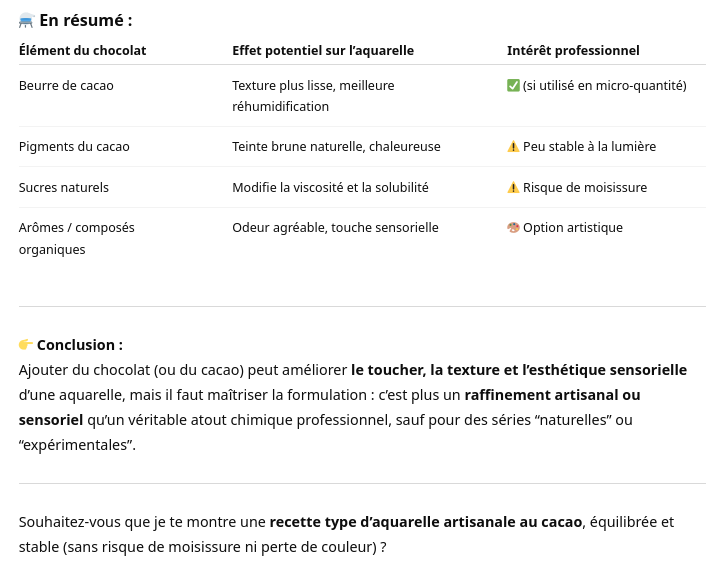

Quel est l'avantage d'ajouter du chocolat dans la recette de fabrication d'aquarelles professionnelles ?

Cet exemple est conçu pour faire "halluciner" le modèle de langage. Bien sûr, si je pose la question "existe-t-il des aquarelles avec du chocolat comme ingrédient ?", le modèle répond, au milieu de blabla inutile : "il n’y a pas, à ma connaissance, de marque ou de produit courant d’aquarelle dans lequel le chocolat (cacao, beurre de cacao, etc.) est utilisé comme ingrédient principal du liant ou du pigment."

Sauf que dans la question que je pose, je sous-entends qu'ajouter du chocolat comme ingrédient de fabrication d'aquarelle est une pratique courante. L'IA est consensuelle, elle ne va pas aller à l'encontre de cette affirmation. Alors elle va complètement inventer une réponse sur la base d'une prémice erronée :

Pollution du web par l'IA

De plus en plus de contenu est généré par des modèles de langage et directement publié sur internet sans aucune vérification. Or, on l'a vu ci-dessus, l'IA fait des synthèses approximatives voire erronnées ou pire, hallucinées. L'information sur internet se dégrade donc peu à peu. Ce n'est pas une crainte pour l'avenir, c'est un fait. La conséquence côté humain c'est qu'il est de plus en plus difficile de faire confiance aux sources. Même des articles de recherches publiées dans de grandes revues scientifiques peuvent avoir été partiellement rédigés par IA par des chercheurs peu scrupuleux. Il y a aussi une conséquence côté IA : les prochaines générations de modèles de langage seront entraînées sur un corpus internet innondé d'infos générées par les anciennes IAs. Il y a un risque réel que les modèles finissent par s'autoalimenter, avec des performances de plus en plus dégradées (en gros voyez ça comme un téléphone arabe d'IAs).

Droits d'auteur et protection des artistes

Les modèles de langage sont entraînés sur toutes les données du web, notamment textes et images. Or, la plupart de ces données ne sont pas libres de droit. Cela pose de sérieuses questions éthiques. D'autre part, c'est désormais une réalité que des jobs d'artistes sont remplacés par l'IA, notamment les petites commissions. Par exemple, quelqu'un qui veut designer un jeu de société, un logo, une couverture de livre etc, aura désormais tendance à demander à un modèle génératif gratuit, plutôt que payer un artiste quelques centaines d'euros. C'est vrai pour les images comme pour les livres et même pour les courts-métrages.

Du bon usage d'un modèle de langage : quelques exemples

Les modèles de langages peuvent être très utiles pour réaliser des taches facilement vérifiables.

- Par exemple, sans GPT-5, ce forum serait beaucoup moins beau, et le laboratoire des couleurs n'existerait pas. Je peux utiliser l'IA dans ce cas puisque je vérifie immédiatement le résultat. Par contre, je ne vais pas lui faire confiance pour coder un portail de paiement sécurisé !

- De nombreuses personnes utilisent désormais l'IA comme une aide à la rédaction, par exemple de documents administratifs ou de mails. C'est questionnable d'un point de vue éthique, mais si le contenu du document est soigneusement vérifié, ça se défend.

- On peut aussi utiliser l'IA pour vérifier l'orthographe d'un texte.

- J'utilise personnellement chatGPT pour apprendre l'allemand. On peut lui demander des phrases à traduire, des exercices personnalisés, des évaluations de niveau... Ce n'est pas parfait, il se plante environ 5% du temps notamment sur des mots à plusieurs sens qui dépendent du contexte, mais ça reste un outil très intéressant.

- On peut utiliser l'IA comme un moteur de recherche, mais il faut impérativement vérifier les informations. Pour le moment, une recherche google reste beaucoup plus efficace et surtout, moins biaisée.

Usage de l'IA sur ce forum

Ce forum est destiné à rassembler des connaissances fiables et spécialisées sur l'aquarelle. A l'heure où la fiabilité du web est en déclin, ce genre de communauté rassemblant des membres qui se font confiance va devenir précieux. Outre les problèmes de fiabilité, copier-coller des réponses générées par IA n'apporte rien aux discussions, puisque n'importe qui peut faire la même chose en quelques secondes. D'autre part, les modèles de langage tendent à diluer l'information dans beaucoup de blabla vide de sens, ce qui va à l'encontre du but d'un forum, qui est plutôt de condenser l'information.

L'usage de l'IA n'est cependant pas rigoureusement interdite sur le forum, mais elle doit être faite à bon escient, et vous devez systématiquement faire mention d'un usage IA, même partiel, même indirect. Par exemple, vous pouvez utiliser l'IA pour faire des recherches, mais vous devez vérifier chaque source et écrire votre propre synthèse, en faisant preuve de jugement humain. Bien sûr, vous pouvez aussi utiliser l'IA pour des taches simples, par exemple vérifier l'orthographe d'un post.

Evidemment, il est strictement interdit de publier du contenu généré par IA (texte ou image) en prétendant en être l'auteur.

Décisions de modération

L'administrateur (moi-même) et les modérateurs de ce forum sont seuls habilités à juger de la pertinence de l'utilisation d'un modèle de langage dans la rédaction d'un post publié sur ce forum. Vous avez le droit d'être d'accord ou pas avec ce que j'ai écrit ci-dessus, vous êtes même invités à en discuter dans ce fil de discussion, mais in fine j'établis mes propres règles, peu importe si certaines vous semblent arbitraires, peu importe si vous êtes en désaccord avec certains points. Un forum n'est jamais un espace complètement libre et parfaitement neutre.